【科学向未来】

作者:曾毅(中国科学院自动化研究所类脑智能研究中心研究员、副主任)

著名作家阿西莫夫1940年在科幻小说中提出了“机器人三原则”:机器人不得伤害人类,或看到人类受到伤害而袖手旁观;机器人必须服从人类的命令,除非这条命令与第一条相矛盾;机器人必须保护自己,除非这种保护与以上两条相矛盾。今天,人工智能逐渐从科幻走向现实,人们对人工智能可能产生的危害也愈加警惕,希望能够为其制定准则以确保人工智能科技和产业向对社会有益的方向顺利发展。

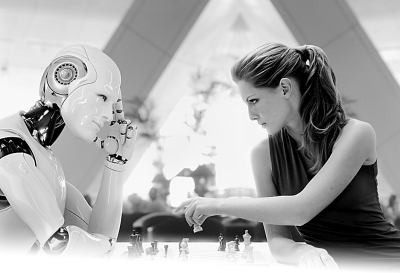

光明图片/视觉中国

1.以和谐互补的方式链接不同的人工智能准则提案

人工智能既是经过数十年锤炼发展出来的科学领域,又是改变未来的重要颠覆性技术。人工智能的研究与发展不仅关系到国家科技、经济发展、社会稳定,更关系到国家在科技、产业领域的国际影响与国际局势。

人工智能在带来机遇的同时也带来潜在的风险与隐患。例如应用最为广泛的深度神经网络模型在对输入引入极小的噪声(如改变图像输入中某个关键的一个像素值)情况下,就有可能使网络的识别和预测结果产生颠覆性的错误(如将青蛙识别为卡车、乌龟识别为枪支)。若没有充分的风险评估,新兴技术在对社会发展带来机遇的同时,很有可能引入不可预计的安全隐患与风险。

现在对于人工智能的发展而言,首要的问题是选择正确的道路。创新、价值、伦理是一个铁三角,创新性技术对社会带来潜在价值的同时,可能存在难以预期的风险,并对社会伦理提出重大挑战。因此,发展人工智能技术普惠经济与社会的同时,关注人工智能的社会属性,从社会风险、伦理准则与治理角度确保人工智能科学、技术、产业的健康、良性发展至关重要。

为了确保发展有益的人工智能,世界上各国政府、非政府组织、科学团体、科研机构、非营利性组织、企业都提出了人工智能发展准则。包括英国政府、国际电子电器工程学会、国际劳工组织。至今,于公开渠道可见的人工智能准则提案已接近40个,涉及以人为本、合作、共享、公平、透明、隐私、安全、信任、权利、偏见、教育、通用人工智能等主题。例如,美国生命未来研究所倡导的阿西洛玛人工智能准则(Asilomar AI Principles)、英国上议院提出的人工智能准则(AI Code)等,都希望通过在人工智能伦理与准则制定方面的领先来引领人工智能的发展。

事实上目前任何一个国家、机构、组织提出的人工智能准则都仅覆盖了少部分主题(更为具体的层面,人工智能准则提案涉及超过50个主要议题),虽然不少准则提案都有自身的特色,有其他方案未能覆盖的考量,但想要构建统一、全面、完善的人工智能准则既是难以实现的,又是没有必要的——难以实现的原因是人工智能这门科学技术本身、人工智能准则、伦理的内涵和外延都是在不断完善的;没有必要的原因是每个国家、组织与机构的准则提案都结合自身实际情况,有组织目标、环境、文化、伦理传统相关的特殊考虑。

笔者认为,真正有价值的做法是认可每一个国家、机构提案在一定范围的意义,而为了更好地实现人工智能的全球治理,重点将不是统一人工智能的准则,而是以更和谐互补的方式链接不同的人工智能准则提案,使其在局部(如国家、组织机构等)有序与一致,世界的全局范围内不同的准则提案仍可交互和协商,最终实现和谐互补、优化共生。

2.调和政府与企业在准则制定上的现存差异

在对不同人工智能准则提案的量化分析中可以看到:相对而言,各国政府对人工智能的潜在风险与安全高度重视,但企业的重视程度相对薄弱。这反映了在企业从事人工智能创新过程中对于潜在风险与安全隐患可能估计不足。例如,在对人工智能风险的评估中,部分企业认为如果总体可能的利益远远超过可预见的风险和不利因素,则可以进行相关探索。但从学术的视角看,一方面,依据潜在利益与风险之间的量化差异决定企业是否采取相关行动本身就是一个危险的视角;另一方面,如果没有站在全社会的全局视角进行综合研判与分析,仅从企业自身视角进行预测与判断,则很有可能因为局限的思考与行动对社会造成潜在的巨大危害。

因此,应当看到政府重视与企业相对不足的考虑之间的差距,并采取引导、监管、建立人工智能产品与服务的风险与安全评估体系等有效措施弥补政府期望与企业实践之间的鸿沟。

同时,一些准则在相关技术途径可能引发风险的方面可能估计不足。例如某些提案中对通用人工智能(各个认知功能达到人类水平,简称AGI)、超级智能(所有认知功能超过人类水平,简称ASI)涉及很有限。

这方面学术机构的讨论和相关研究应当为政府决策提供有力支撑,例如阿西洛玛人工智能准则中提出超级智能以全人类受益为标准来发展,剑桥大学近期提出并正在进行一项名为“通用人工智能的实现途径及潜在风险”的研究。

3.兼顾专用人工智能和通用人工智能的发展

在人工智能顶层设计当中,是否发展通用人工智能,还是仅限于发展领域特定的专用人工智能?这是诸多人工智能准则提案中主要存在的巨大分歧。

例如,欧盟人工智能研究实验室联合会(CLAIRE)就明确提出应限制人类水平智能、通用智能以及超级智能的发展。德国的人工智能计划也集中于发展专用人工智能。而阿西洛玛人工智能准则、OpenAI等机构提出的人工智能准则中则明确提出应当对更安全的通用人工智能进行充分考虑与发展。

事实上发展专用智能并不一定能够完全避免风险,因为专用智能系统在应用中很可能遇到不可预期的场景, 具备一定的通用能力反而有可能提升智能系统的鲁棒性和自适应能力。因此应针对智能的通用性这个主题链接不同国家、组织、机构的考虑,实现顶层设计的互补。

人类认知功能的多样性以及人工智能应用场景的复杂性使得很难对人工智能的风险、安全以及伦理体系进行绝对完善的建模,特别是涉及到人工智能产品、服务与具有不同文化背景的人类群体交互。任何国家都应制定适应本国的实际社会、科技、经济发展与文化需求的人工智能准则。但更关键的是需要全世界不同政府、学术组织、产业界深度交互与协同,对人工智能的发展进行对全社会有益的战略性设计,对其潜在的社会风险与伦理挑战进行系统性评估与预测,并构建世界范围内总体和谐、互为补充、优化共生的发展准则。

[责编:王丽媛]